基于极小极大扩散的高效数据集蒸馏方法研究

本课题旨在探索一种基于生成扩散技术的高效数据集蒸馏方法,以解决现有方法在处理大规模数据集时的计算瓶颈问题。

工科

SCI

CCF

计算机科学与技术

人工智能

数据集蒸馏技术

申请匹配

咨询客服 课题详情

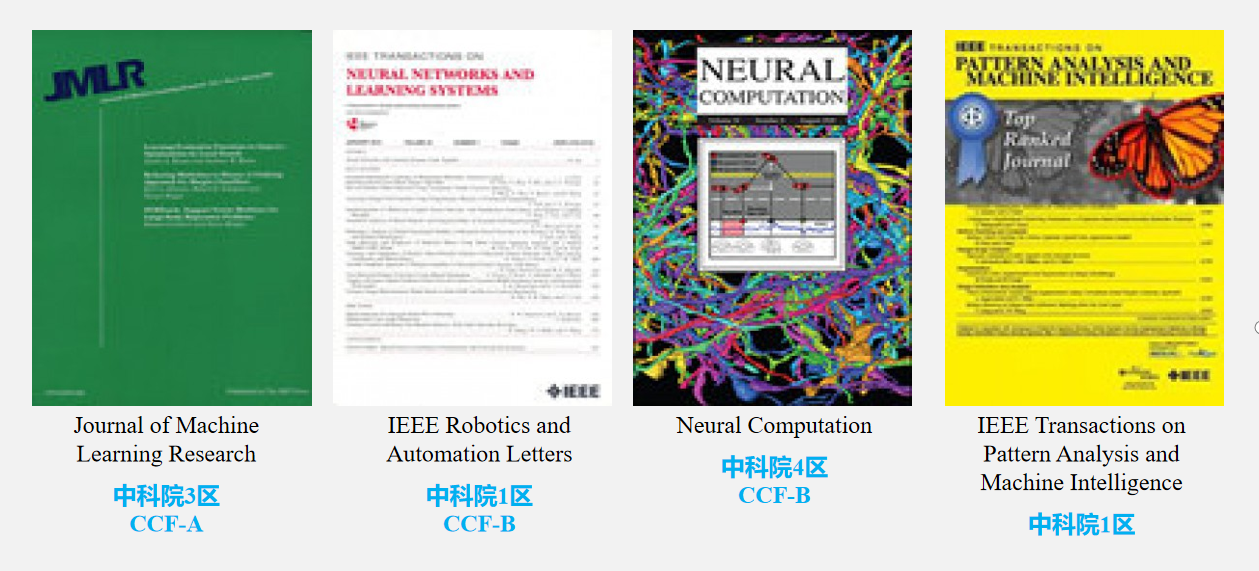

【课题推荐发表期刊】

【课题背景】

深度学习模型的训练往往依赖于大规模数据集,这导致了存储和计算资源的巨大消耗。数据集蒸馏技术旨在通过生成一个小型的代理数据集来压缩原始数据集,从而降低训练成本。然而,以往的蒸馏方法通常依赖于逐样本的迭代优化过程,当每个类别的图像数量或图像分辨率增加时,所需的计算时间和资源会急剧增加,限制了其在实际应用中的可行性。

本课题旨在探索一种基于生成扩散技术的高效数据集蒸馏方法,以解决现有方法在处理大规模数据集时的计算瓶颈问题。通过将生成模型引入数据集蒸馏过程,并设计专门的训练策略,有望在保证代理数据集有效性的同时,大幅降低蒸馏过程的计算开销,为深度学习模型的训练提供更轻量级的解决方案。

【课题方向参考】

生成扩散模型在数据集蒸馏中的应用:研究如何将生成扩散模型应用于数据集蒸馏任务,设计合适的网络结构和训练流程

表征性和多样性增强:针对代理数据集的构建,探索如何通过极小极大准则增强生成图像的表征性和多样性,确保其有效性

分层扩散控制的理论模型:建立分层扩散控制的理论模型,从理论上证明所提出的极小极大方案能够在不影响生成质量的前提下实现表征性和多样性的增强

性能评估与比较:在ImageNet等公开数据集上进行实验,验证所提出方法的有效性,并与现有数据集蒸馏方法进行比较

【适合人群】

计算机科学专业相关方向的硕士研究生,具备扎实的机器学习和深度学习基础,熟悉Python编程和深度学习框架,对生成模型和数据集蒸馏领域有浓厚兴趣的研究生。

【课题收获】

高质量论文一篇(SCI/CCF定向期刊)

SCI/CCF期刊投递与发表指导

结业证书

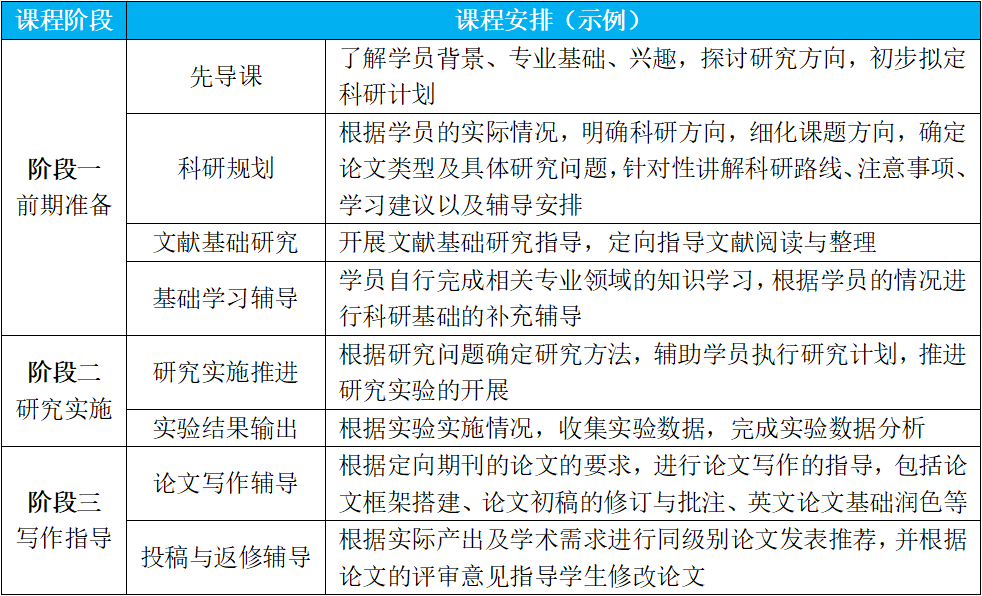

【课题安排】

研究周期预估六个月左右,具体视学员情况调整

【推荐阅读】

课题导师 查看详情 >

Prof. LiKY28443

顶级科研院所研究员

计算机视觉人工智能分布式计算自然语言处理三维点云定位

立即添加好友,了解更多